Klaus Mainzer

Zur Veränderung des Theoriebegriffs im Zeitalter von Big Data und effizienten Algorithmen

13 Seiten | Autor: Klaus Mainzer

Wir leben in einem datengetriebenen Zeitalter, dessen Entwicklung durch exponentielle Wachstumsgesetze von Datenmengen, Rechner- und Speicherkapazitäten beschleunigt wird. Manchen Autoren halten theoretische Fundierungen bereits für überflüssig, da in der Wirtschaft immer effizientere Algorithmen immer schneller immer bessere Kunden- und Produktprofile voraussagen. In der Wissenschaft prophezeien Autoren wie S. Wolfram eine neue Form der Forschung, die ebenfalls nur noch auf effiziente Algorithmen und Computerexperimente setzen, die angeblich „traditionelle“ mathematische Theorien überflüssig machen. Diese Parolen sind brandgefährlich, haben aber einen richtigen Kern. Gefährlich sind diese Positionen, weil Theorien ohne Daten zwar leer sind, aber Daten und Algorithmen ohne Theorie blind bleiben und unserer Kontrolle entgleiten. Richtig ist, dass sich der traditionelle Theoriebegriff in vielfacher Weise verändert, sowohl beim Entdecken und Finden von Hypothesen durch Machine Learning als auch bei theoretischen Erklärungen durch Computerexperimente und der Voraussage durch Predictive Analytics. Entscheidend ist aber vor allem die Prüfung und Kontrolle von Algorithmen, die durch neuartige Theorien möglich werden. Nur so können wir sicher sein, dass uns am Ende Big Data mit ihren Algorithmen nicht um die Ohren fliegen.

PDF: 0,00 €

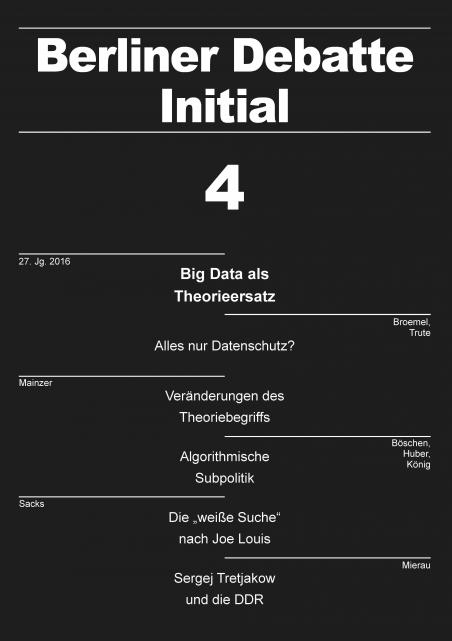

Big Data als Theorieersatz

80 Seiten | Autor: Stefan Böschen, Roland Broemel, Georg Huber, René König, Klaus Mainzer, Jochen Mayerl, Thomas Müller, Gregor Ritschel, Jan-Felix Schrape, Hans-Heinrich Trute Christian Wadephul, Katharina Anna Zweig

Die sieben Beiträge des Schwerpunkts zum Vorzugspreis - Big Data ist zum Schlagwort für das Sammeln und Auswerten enormer Datensätze geworden, die aus den digitalen Aktivitäten der Menschen gefiltert und von Algorithmen auf Muster hin analysiert werden. Wirtschaft, Politik, Alltagskommunikation, Öffentlichkeit, Kultur und Sport – all das wird von Big Data Schritt für Schritt durchdrungen. Doch was bedeutet Big Data für Wissenschaft und Forschung, vor allem: für die Sozial- und Geisteswissenschaften? Diese Frage steht im Mittelpunkt des aktuellen Themenschwerpunkts. Sie zu stellen, liegt nicht zuletzt deshalb nahe, weil sich mit dem Aufstieg von Big Data eine Provokation verbindet, die direkt auf das Selbstverständnis der Sozial- und Geisteswissenschaften zielt. Auf den Punkt gebracht hat sie der britische Journalist und Unternehmer Chris Anderson vor fast zehn Jahren, als er mit markigen Worten das Ende der Theorie und die Überflüssigkeit wissenschaftlicher Methoden verkündete. Die sieben Beiträge fragen einerseits, was von der steilen These, Big Data trete an die Stelle der Theorie, zu halten ist. Andererseits erkunden sie soziale, rechtliche und politische Implikationen von Big Data und demonstrieren damit, dass sozial- und geisteswissenschaftliche Analysen nicht überflüssig werden, sondern nötig sind, um Big Data zu begreifen.

PDF: 0,00 €